концепция проекта

Проект исследует, как личный визуальный архив может быть преобразован в генеративный язык. Я обучила Stable Diffusion на собственных фотографиях, которые за последние годы были сняты мной на пленку в разных местах. Я хотела перенести не конкретные сюжеты, а атмосферу: холодные зелено-синие оттенки, зернистость, засветы и ощущение «живой» оптики. Ключевая цель — получить новые изображения, которые выглядят как продолжение моего фотоархива.

исходные изображения

Для обучения был собран и подготовлен датасет из личных фотографий (квадратный формат 1:1, единый размер). В итоговой версии обучения использовалось около 30 изображений с преобладающими природными и лесными мотивами: мох, влажные фактуры, приглушенный свет, естественные текстуры, люди в пейзаже. Перед обучением изображения были приведены к единому формату, чтобы модель лучше улавливала стилистические признаки.

процесс обучения

Обучение строилось как дообучение Stable Diffusion XL методом DreamBooth LoRA на моем личном архиве пленочных фотографий. Исходные изображения я предварительно привела к единому формату (квадрат 1:1 и одинаковое разрешение), чтобы модель училась не на случайных различиях размеров, а на устойчивых визуальных признаках: цветовой гамме, фактурах и характере света. В финальном запуске использовался компактный датасет из природных кадров (мох, лес, влажные поверхности), потому что именно он оказался наиболее консистентным по стилю. Обучение выполнялось на GPU в облачном ноутбуке; по ходу сохранялись промежуточные чекпоинты, что позволило сравнивать результаты на разных этапах и выбрать наиболее удачную версию весов. Для генерации я использовала стиль-токен ohfilm style, а также негативные промпты для снижения артефактов и улучшения реалистичности.

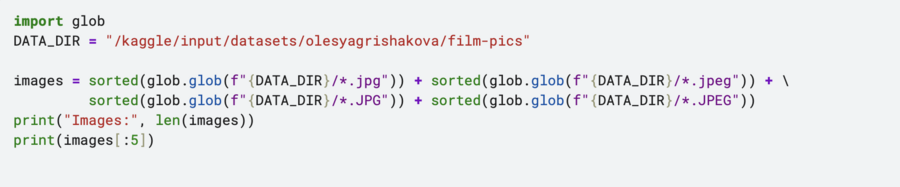

Импорт датасета

Дополнительно для улучшения качества я подбирала параметры генерации (число шагов, guidance scale, размер кадра) и корректировала текстовые запросы под сильные стороны датасета: не портреты, а пейзажные и текстурные сцены.

Обучение модели

Основные параметры (финальный запуск): разрешение обучения: 768 количество шагов: 400 prompt-идентификатор стиля: ohfilm style оптимизация: fp16, gradient checkpointing

Для повышения качества использовались:

негативный промпт (отсечение артефактов, убрала людей, так как в первом запуске были нереалистичные генерации), умеренный guidance_scale, параметры, близкие к train-настройкам, серия тестов по формулировкам промптов с акцентом на пленочность (grain, light leaks, soft haze, muted tones).

Обучение и генерация выполнялись в облачной среде (Colab/Kaggle GPU), так как локальных ресурсов было недостаточно.

итоговая серия

Итогом стала серия из 8 изображений с единой визуальной логикой. Таким образом, рабочий процесс в ноутбуке позволил перейти от личного фотоархива к устойчивому генеративному стилю и получить материал, пригодный для публикации в формате лонгрида.

Визуально итоговая серия объединена холодной зелено-синей палитрой, пленочным зерном, мягкими засветами и эффектом «влажной» фактуры, но внутри нее есть вариации: в одних изображениях акцент на крупных деталях (кора, мох, трава), в других — на общих планах (тропа, лесной просвет, вода, туман); также меняются освещение, плотность дымки и глубина пространства. То есть нейросеть не копирует исходные кадры буквально, а воспроизводит их стилистическое ядро и создает новые сцены в едином авторском визуальном языке.

описание применения генеративной модели

Stable Diffusion XL с дообучением через DreamBooth LoRA: модель применялась для обучения на основе датасете и генерации изображений. Помимо обученной нейросети использовался ChatGPT для: структурирования описания проекта, редактуры экспликации, подбора и уточнения промптов для итоговой серии. https://chatgpt.com