ИДЕЯ ПРОЕКТА

Основная цель проекта — обучение модели Stable Diffusion XL генерации изображений в уникальном стиле советской художницы Татьяны Мавриной. Для этого будут использованы методы обучения DreamBooth и LoRA.

Татьяна Маврина — яркая представительница русского искусства XX века, известная своим самобытным стилем, сочетающим народные мотивы, импрессионистические приемы и экспрессивную цветовую палитру. Выбор художницы для данного проекта обусловлен желанием исследовать, как генеративная модель сможет уловить и воспроизвести не только узнаваемые визуальные элементы её живописи, но и передать её авторское видение — радостное, яркое и наполненное жизнью.

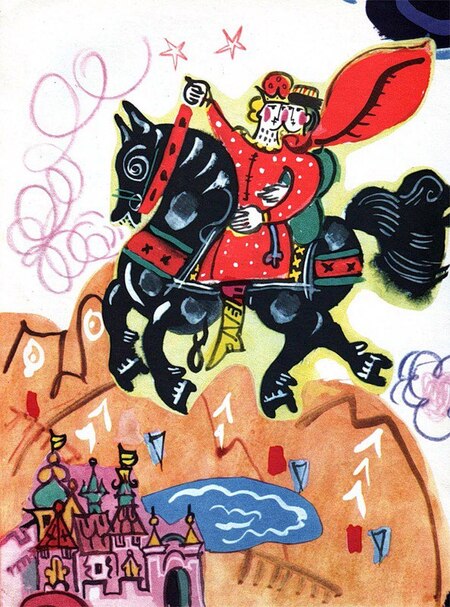

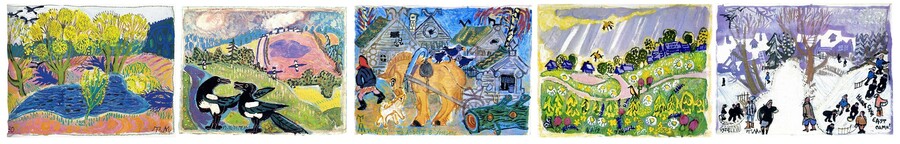

Иллюстрации Татьяны Мавриной

Сможет ли модель перенять не только внешние признаки живописи, но и сам визуальный язык художницы? Прежде всего — настроение, ритм линий, эмоциональную выразительность и общую декоративность.Текст

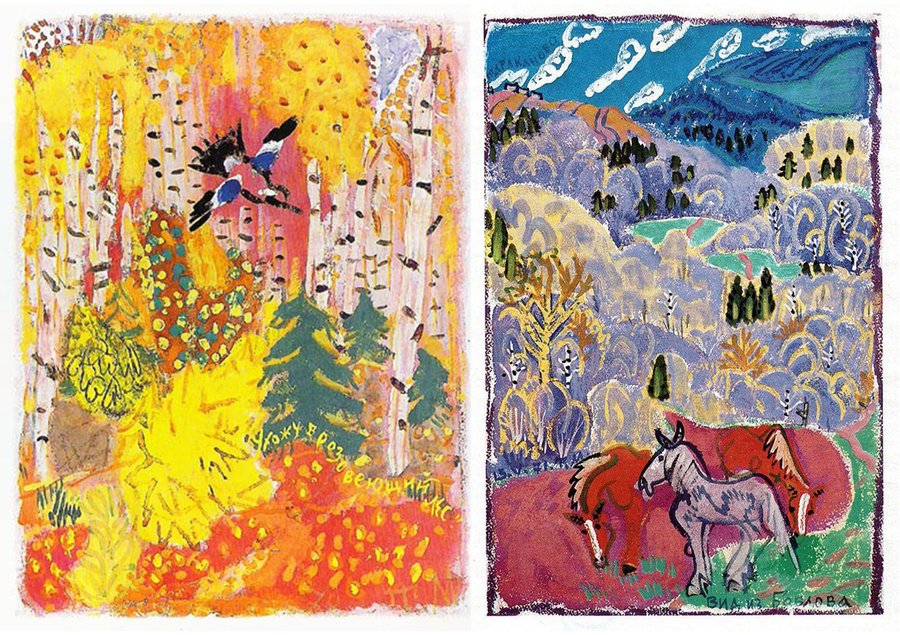

Иллюстрации Татьяны Мавриной

Для обучения модели был сформирован датасет из 44 изображений, включающий разнообразные работы Татьяны Мавриной. В него вошли: пейзажи, портреты, натюрморты, а также иллюстрации к сказкам и литературным произведениям

Такой набор был нужен, чтобы модель увидела стиль в разных жанрах. Это важно, потому что задача состояла не в повторении одного сюжета, а в переносе общего художественного языка на разные сцены.

Исходные изображения до перевода в формат 512 × 512

Техническая реализация

Подготовка инфраструктуры и аутентификация:

Подключение Google Drive для хранения данных. Аутентификация в Hugging Face Hub для доступа к базовым моделям (notebook_login). Установка необходимых библиотек (diffusers, transformers, accelerate). Обработка данных (Preprocessing):

Кроппинг: Использование PIL для обрезки изображений в квадратный формат (crop_to_square). Организация: Создание структуры папок и очистка имен файлов. Автоматическое аннотирование (Image Captioning):

Загрузка предобученной модели BLIP (BlipForConditionalGeneration) для автоматического создания текстовых описаний к изображениям. Генерация caption для каждого изображения, что критически важно для последующего обучения модели понимать контекст. Конфигурация и обучение:

Настройка окружения через библиотеку accelerate для эффективного использования GPU. Запуск процесса обучения (вероятно, Dreambooth или LoRA) на основе загруженных изображений. Используются скрипты обучения из библиотеки diffusers. Генерация и визуализация (Inference):

Загрузка обученных весов в DiffusionPipeline. Генерация новых изображений по текстовым промптам. Визуализация результатов с помощью matplotlib: создание сеток изображений (plt.imshow) для оценки качества обучения.

Кодовая вставка 1: обрезка изображений под формат 512×512

Кодовая вставка 3: генерация картинок

Итоговая серия: 10 изображений и промпты

ИСПОЛЬЗОВАННЫЕ НЕЙРОСЕТИ:

Stable Diffusion XL https://huggingface.co/stabilityai/stable-diffusion-xl-base-1.0

BLIP https://huggingface.co/Salesforce/blip-image-captioning-base

DreamBooth https://huggingface.co/papers/2208.12242